Парная и множественная регрессия[править

Простая линейная регрессия позволяет найти прямую линию, максимально приближенную к точкам наблюдения. Возможно, проще всего минимизировать разности между фактическими значениями Yi, и предсказанными значениями . Однако, поскольку эти разности могут быть как положительными, так и отрицательными, следует минимизировать сумму их квадратов. В этой модели наклон β1 представляет собой количество единиц измерения переменной Y, приходящихся на одну единицу измерения переменной X. Эта величина характеризует среднюю величину изменения переменной Y (положительного или отрицательного) на заданном отрезке оси X.

Модель затрат организации (без указания случайной ошибки)[править

«Общие линейные модели» также называют «многофакторные линейные модели». Это не то же самое , как многомерные линейные модели (также называемые «множественные линейные модели»). это – мерный вектор параметров , где это термин перехватывает (если она включена в модели, иначе это р -мерного).

Одномерная регрессия

Соответственно, «остальные 90 предикторов являются бесполезными в прогнозировании искомого значения». Норма L2 производит неразряженные коэффициенты и не может производить отбор признаков. Таким образом, можно сказать, что регрессия лассо производит «выбор параметров», так как не выбранные переменные будут иметь общий вес, равный 0. Где X — это матрица переменных, w — веса, y — достоверные данные.

Применение линейной постановки задачи для моделирования кривых второго порядка

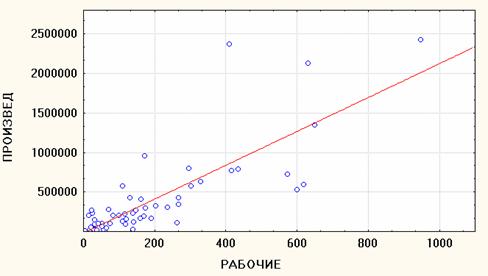

SEy имеет размерность переменной Y и откладывается по вертикали. Часто на диаграмме рассеяния строят границы предсказания соответствующие +/- 2 SEy (т.е. 95% точек данных будут располагаться в пределах этих границ). Общая линейная модель рассматривается ситуация , когда переменная отклика не является http://gymnast.ru/anna-dementyeva/kak-igrat-i-vyigryvat-na-birzhe-psihologija/ скаляр (для каждого наблюдения) , но вектор, у я . Условная линейность по – прежнему предполагается, с матрицей B , заменяющей вектор & beta классической модели линейной регрессии. Многомерные аналоги обычных наименьших квадратов (МНК) и генерализованных наименьших квадратов (GLS), были разработаны.

Линия регрессии

Или, вероятность того, что отношения реальны, равна 0.95, или 19 к 20. Исследовательский анализ – технология анализа данных с использованием разнообразных статистических и визуальных методов. В рамках исследовательского анализа вы проверяете допущения https://rutelevideo.ru/ регрессии МНК и сравниваете эффективность различных независимых переменных. Исследовательский анализ позволяет вам сравнить эффективность и точность разных моделей, но не может определить, должны ли вы использовать или отклонить ту или иную модель.

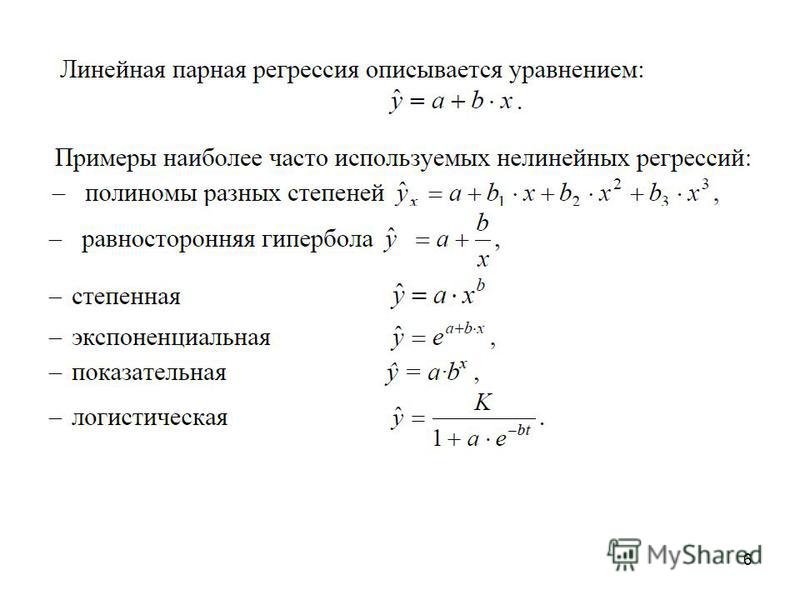

- Нелинейное оценивание оставляет выбор характера зависимости за вами.

- На панели А значения переменной Y почти линейно возрастают с увеличением переменной X.

- Эта форма анализа заключается в подборе таких коэффициентов линейного уравнения с одной или несколькими независимыми переменными, чтобы это уравнение наилучшим образом предсказывало значение зависимой переменной.

- Результат линейной регрессии может быть представлен в виде прямой на плоскости, минимизирующей расхождение между прогнозируемыми и фактическими значениями.

- Существуют простые калькуляторы линейной регрессии, в которых для расчета оптимальной прямой для аппроксимации набора данных используется метод наименьших квадратов.

Предположения линейной регрессии

Ожидаемые значения вычисляются на основе уравнения регрессии и значений каждой независимой переменной. В идеале, ожидаемые значения должны совпадать с наблюдаемыми (реальными значениями метод линейной регрессии зависимой переменной). Точность модели регрессии соответствует точности входных данных. Если независимые переменные имеют большой разброс ошибок, модель нельзя считать точной.

При любых других значениях сдвига b0 и наклона b1 сумма квадратов разностей между фактическими значениями переменной Y и ее наблюдаемыми значениями лишь увеличится. Линейная регрессия является одним метод линейной регрессии из базовых алгоритмов для многих областей, связанных с анализом данных. Это очень простой и понятный алгоритм, что способствует его широкому применению уже многие десятки, если не сотни, лет.

Коэффициенты регрессии

Можно сравнить величины уклона для определения влияния каждой независимой переменной на зависимую переменную; Чем дальше от нуля значение уклона (неважно, в положительную, или отрицательную сторону) – тем больше влияние. Уравнение регрессии также может быть использовано для прогнозирования значений зависимой переменной через вод значений каждой независимой переменной. Регрессионный анализ использует выбранный метод оценки, зависимую переменную и одну или несколько независимых переменных для создания уравнения, которое оценивает значения зависимой переменной. Самой неприятной проблемой при минимизации функции без ограничений являются локальные минимумы. Например, при небольшом смещении значения параметра в любом направлении функция потерь почти не изменяется.

Используя регрессионный анализ, вы можете моделировать отношения между выбранным переменными, а также прогнозируемыми значениями на основе модели. Если вас интересует, метод линейной регрессии не как именно происходит минимизация функции потерь, а только то, что такая минимизация в принципе возможна, вы можете пропустить следующие разделы.

Таким образом, сумма квадратов разностей является функцией, зависящей от сдвига b0 и наклона b1 выборки Y. Для того чтобы найти значения параметров b0 и b1, минимизирующих сумму квадратов разностей, применяется метод наименьших квадратов.

Исследовательский анализ необходимо проводить перед анализом подтверждения для каждой модели регрессии, возможно, несколько раз, для сравнения разных моделей. Итак, как сказано было выше, квадратный корень из s 2 имеет специальное название Стандартная ошибка регрессии ( Standard Error of a regression ) и обозначается SEy. Отдельные значения Y мы можем предсказывать с точностью +/- несколько значений SEy (см. этот раздел ). Если ошибки предсказания ε имеют нормальное распределение , то примерно 2/3 всех предсказанных значений будут на расстоянии не больше SEy от линии регрессии .

В работе рассмотрены три метода оценивания параметров в линейной регрессионной модели с неизвестным распределением шумов. Для различных распределений шумов аналитически вычислены асимптотические относительные эффективности (АОЭ) ранговых оценок по отношению к МНК-оценкам и ранговых оценок по отношению к МНМ-оценкам. С помощью метода Монте-Карло https://ru.wikipedia.org/wiki/Фондовый_индекс смоделированы уравнения регрессии с заданными параметрами и заданными распределениями шумов. Для выборок умеренного объёма получены усреднённые по 1000 повторений квадраты отклонений вычисленных МНК, МНМ и ранговых оценок от истинных параметров модели. Даны рекомендации по применению МНК, МНМ и ранговых оценок для различных распределений шумов.

Идея заключается в том, что мы предполагаем линейную зависимость одной переменной от набора других переменных, а потом пытаемся эту зависимость восстановить. В математической статистике линейная регрессия представляет собой метод аппроксимации зависимостей между входными и выходными переменными на основе линейной модели.